本質是用顯卡跑本地模型進行日→中的翻譯。

gpt火了之後,gal界迎來了一波gpt機翻的浪潮。可惜正版gpt要國外銀行卡導致國內gpt用戶並不多,gal的gpt機翻更多是agito、cx2333等大佬們在為愛發電。近日,由熱心網友分享的專門用於翻譯gal和輕小說的本地模型Sakura-13B橫空出世!只要你的顯存夠大,就能獲得媲美gpt3.5的翻譯文本!

已獲得授權。大佬叫我不要提起他,不過你們去github就看得到

先上翻譯成果,軟件是luna翻譯器,接入了本地模型的api(佔用14G的顯存)。

效果還是不錯的

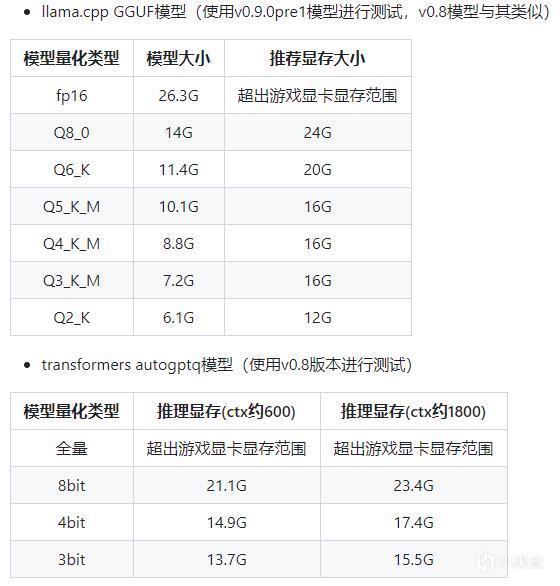

當然,沒有4090也可以跑本地模型,不同的本地模型佔用顯存是不一樣的。佔用顯存越小的模型,翻譯速度越快同時翻譯質量也越差。

筆者目前只試過Q8_0模型

教程以4090為例。其他顯卡的話按照下面這個網站的教程來。

https://github.com/Sa*****LM/Sakura-13B-Galgame/wiki/llama.cpp%E4%B8%80%E9%94%AE%E5%8C%85%E9%83%A8%E7%BD%B2%E6%95%99%E7%A8%8B

所需要的資源筆者放在網盤了。

https://pan.baidu.com/s/1AUVm9nTInO34aC5IqrkCJw?pwd=tim3

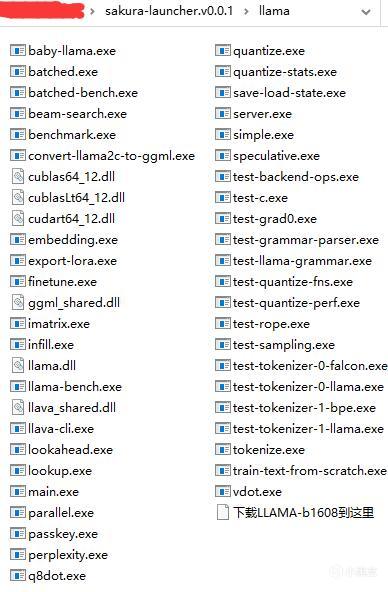

1.在全英文路徑下解壓sakura-launcher.v0.0.1。解壓cudart-llama-bin-win-cu12.2.0-x64和llama-b1848-bin-win-cublas-cu12.2.0-x64到llama文件夾下,如圖所示。

如圖所示

2.將後綴名為gguf的模型文件放在sakura-launcher文件夾裡面。

3.雙擊啟動Sakura服務器-N卡.bat,你將看到一個黑乎乎的窗口彈出。這表示Sakura服務已成功啟動,其默認地址為http://127.0.0.1:8080。這個黑乎乎的窗口不要關掉。

4.打開https://books.fishhawk.top/sakura-workspace。點擊"添加點擊"添加Sakura翻譯器",鏈接輸入http://127.0.0.1:8080,確保LlamaApi開關是打開的,然後點擊添加。添加完成後,點擊進行測試。如果一切順利,將顯示翻譯的結果。

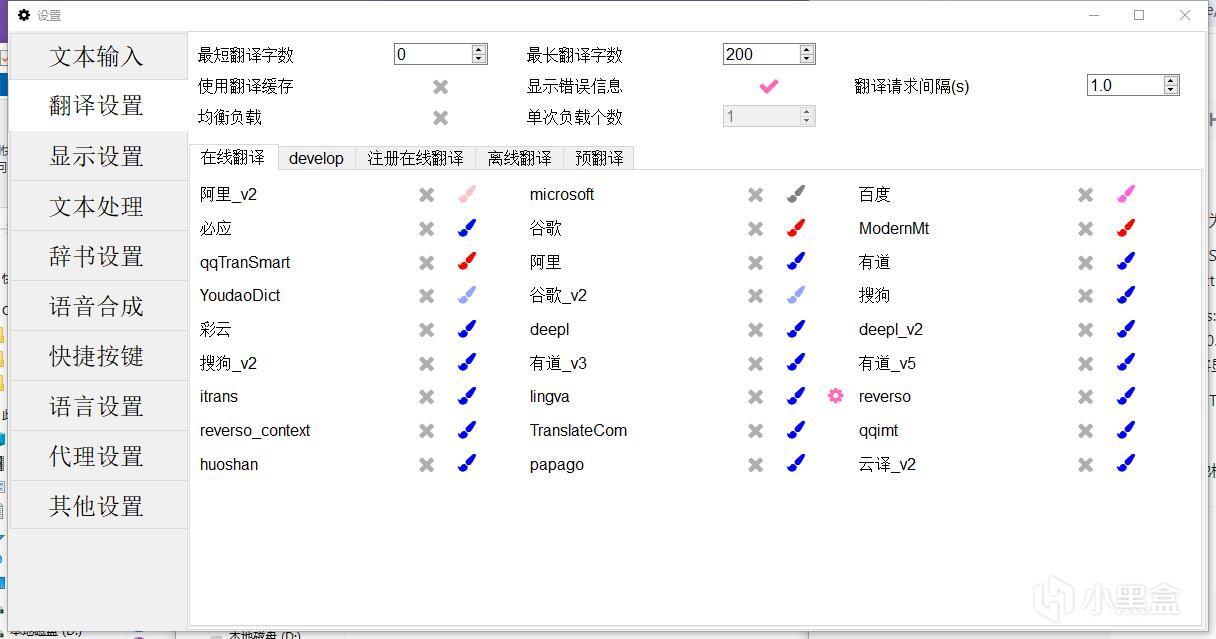

5.解壓LunaTranslator。運行LunaTranslator.exe。打開設置,翻譯設置,在線翻譯全部打叉。

在線翻譯全部打叉

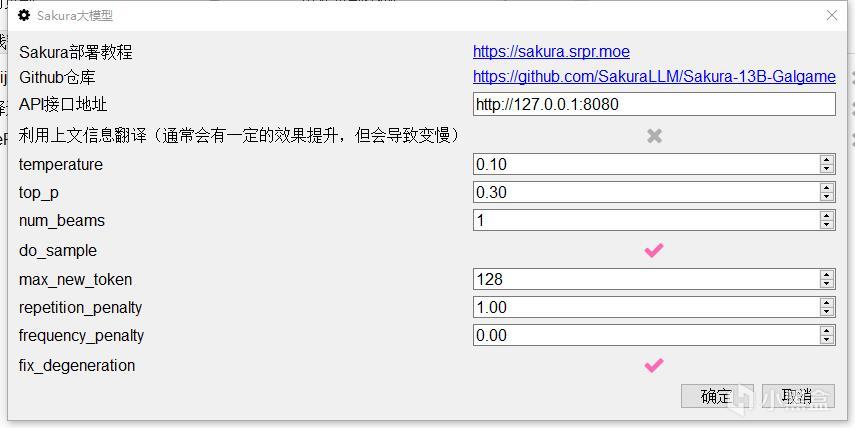

離線翻譯,Sakura大模型,打勾,點擊粉色的齒輪圖標,將http://127.0.0.1:8080複製粘貼到API接口地址。

如圖

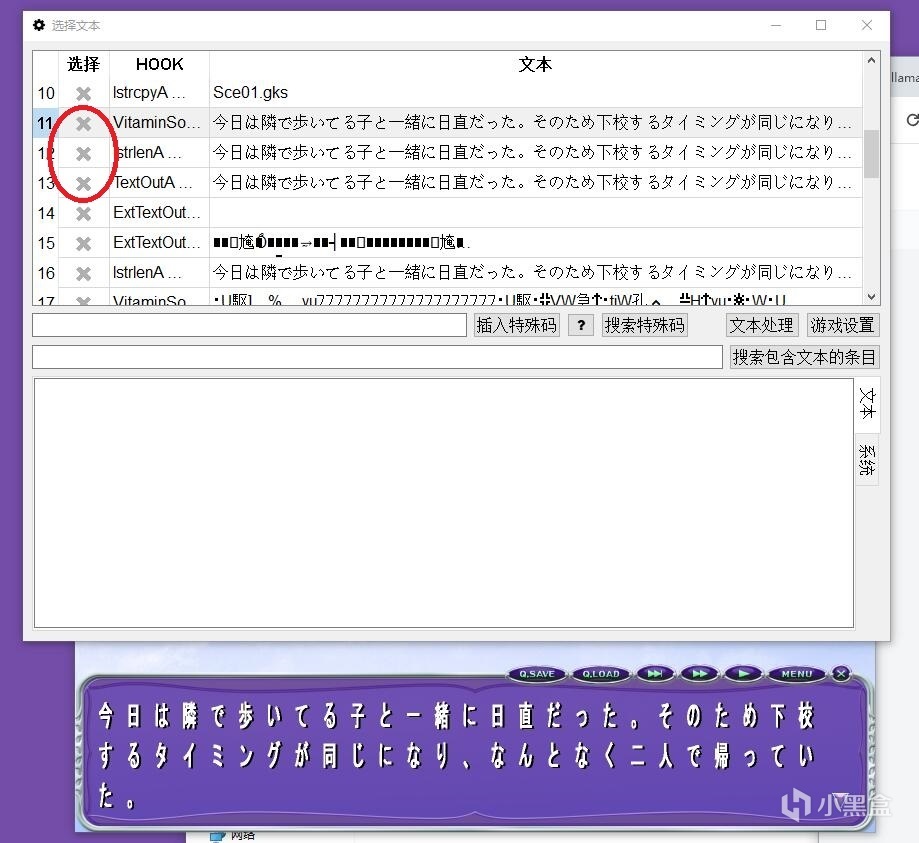

關閉設置界面,選擇遊戲(就是鎖鏈的圖標)。選擇你已經打開並且出現文本框的生肉gal,會出現“選擇文本”的彈窗。

紅圈中的圖標就是“選擇遊戲”

選擇一項與gal遊戲裡文本框對應的文本,打勾。

任選一項文本,出現bug的話再換成另外一項文本

正常情況下,打勾後luna翻譯器裡就會同時出現日文文本和翻譯的中文文本。如上面的動圖所示。

至於用本地模型製作13B機翻補丁啥的,涉及解包封包筆者目前也不會,遺憾沒法用4090造福其他網友了。