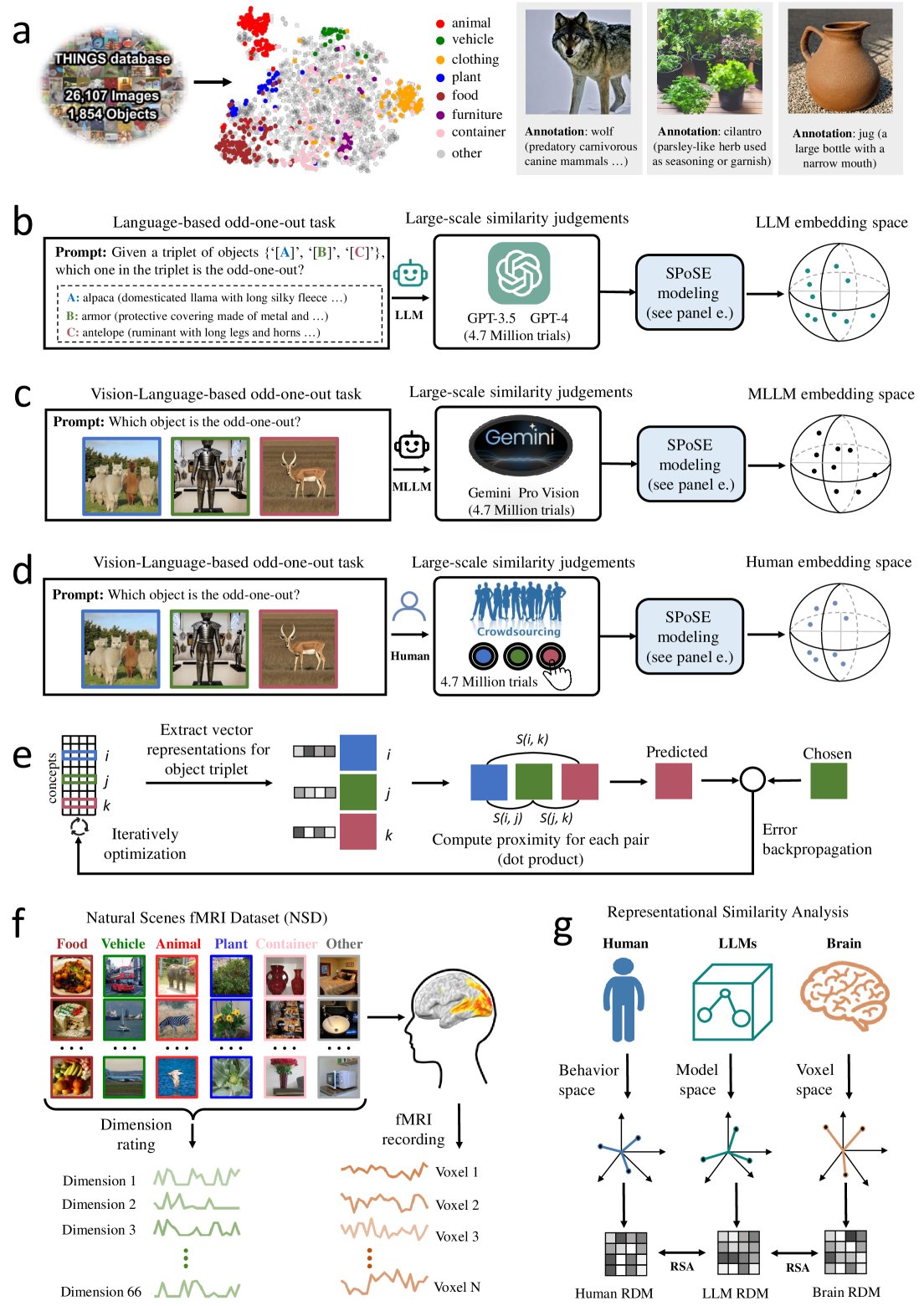

近期发表的一项研究探讨了大型语言模型(LLM)和多模态大型语言模型(MLLM)在概念表示方面是否能够模拟人类大脑的功能。该研究由一个国际科学家团队完成,他们通过分析近470万次的三元组判断数据,揭示了人工智能如何理解和分类自然物体。

研究团队选取了1854种自然物体,并采用一种称为“稀疏正相似性嵌入”(SPoSE)的方法,从中提取了66个维度的概念表示。这些表示不仅稳定而且具有高度的预测能力,显示出与人类心智模型相似的语义聚类特性。

通过与人类大脑活动模式的对比,研究人员发现,无论是LLM还是MLLM的物体表示与大脑中的多个功能区域(如EBA、PPA、RSC和FFA等)的神经活动模式都有很强的一致性。这些发现为人工智能的发展提供了新的视角,表明通过大规模语言和图像数据的训练,人工智能可以发展出与人类相似的概念表示能力。

此外,研究还探讨了LLM和MLLM在理解物体类别方面的能力。结果显示,这些模型能够识别出18个高级别的物体类别,如动物、食物和工具等,其准确率远高于随机水平,进一步证明了它们在无需特定任务训练的情况下也能表现出类似人类的分类能力。

这项研究的首席科学家表示,这一发现不仅增强了我们对人工智能内部运作的理解,也为未来开发更加人性化的人工智能系统提供了可能。他们希望通过进一步的研究,探索人工智能在更广泛的自然语境中的应用潜力,例如在提供个性化助手和改善机器人系统交互方面。

研究结果已经在科学期刊上发表,并引起了学术界和技术界的广泛关注。随着人工智能技术的不断进步,其在模拟和扩展人类认知能力方面的潜力正在逐渐显现,预示着未来可能出现更多创新的人机协作模式。