最近一直在用deepseek的r1模型寫文案摸魚,不得不說確實功能很強大。但是一直網絡繁忙是個問題,於是自己找了一些教程本地化部署,這裡介紹的是ollama。

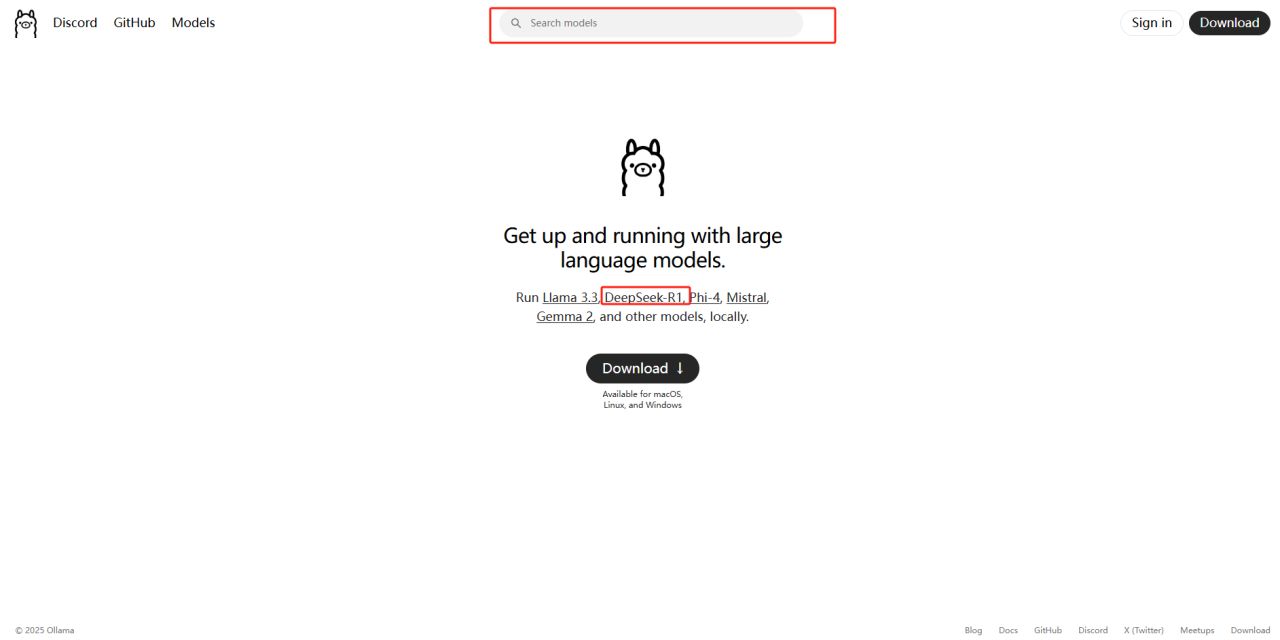

第一步:下載ollama

1.訪問ollama官網

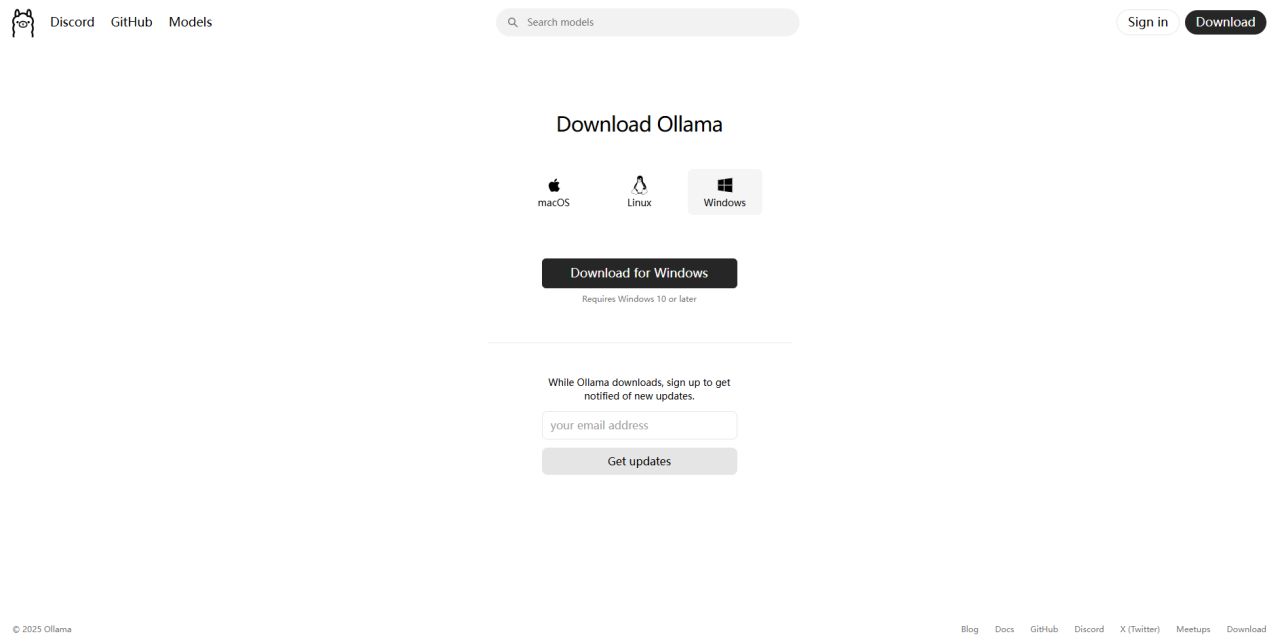

2.點擊下載(Download)

3.選擇你自己的操作系統下載,我這裡以win系統為例。

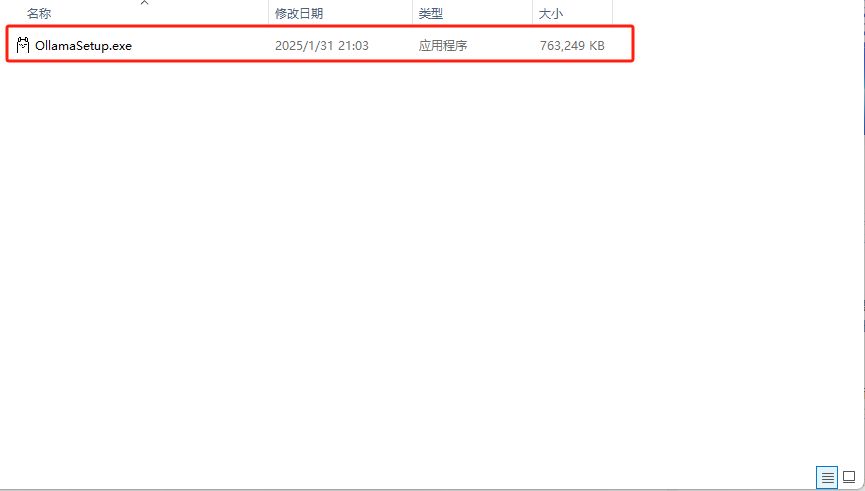

4.雙擊安裝包,安裝ollama,等待安裝完成

第二步:安裝deepseek R1大模型

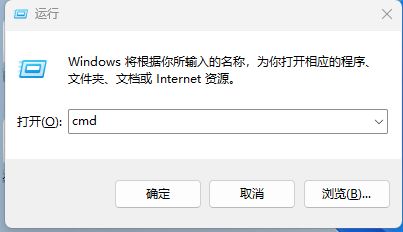

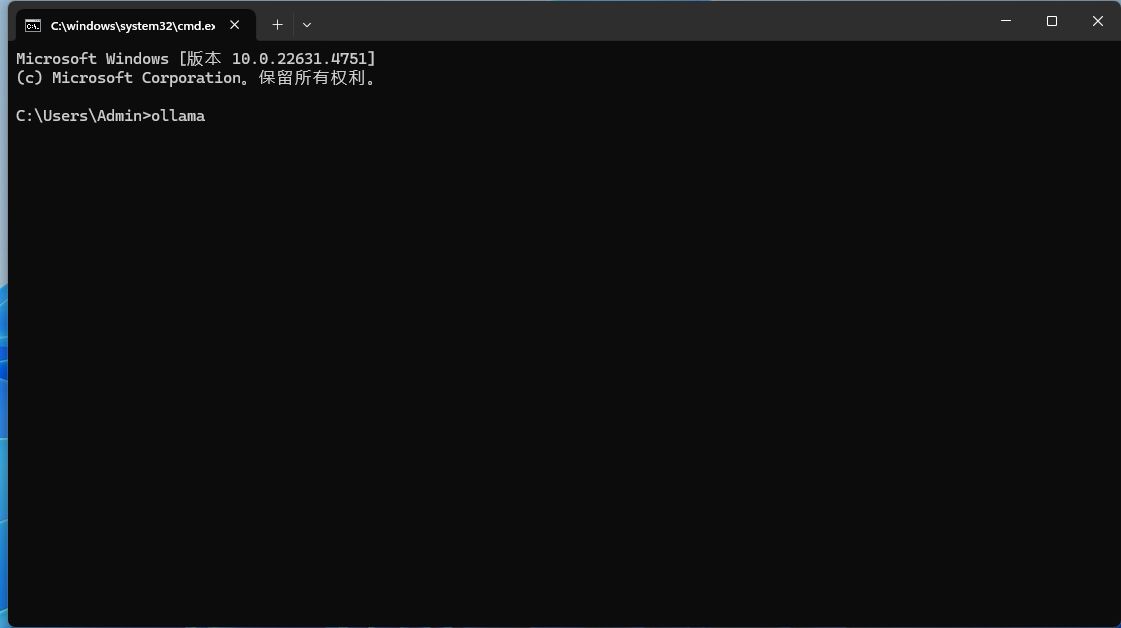

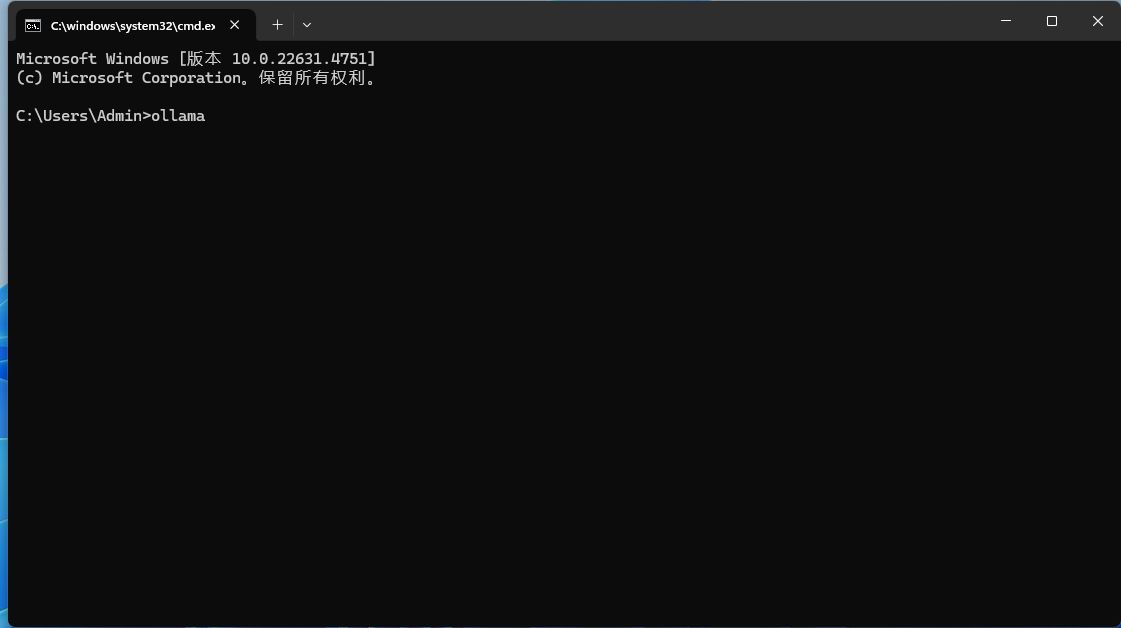

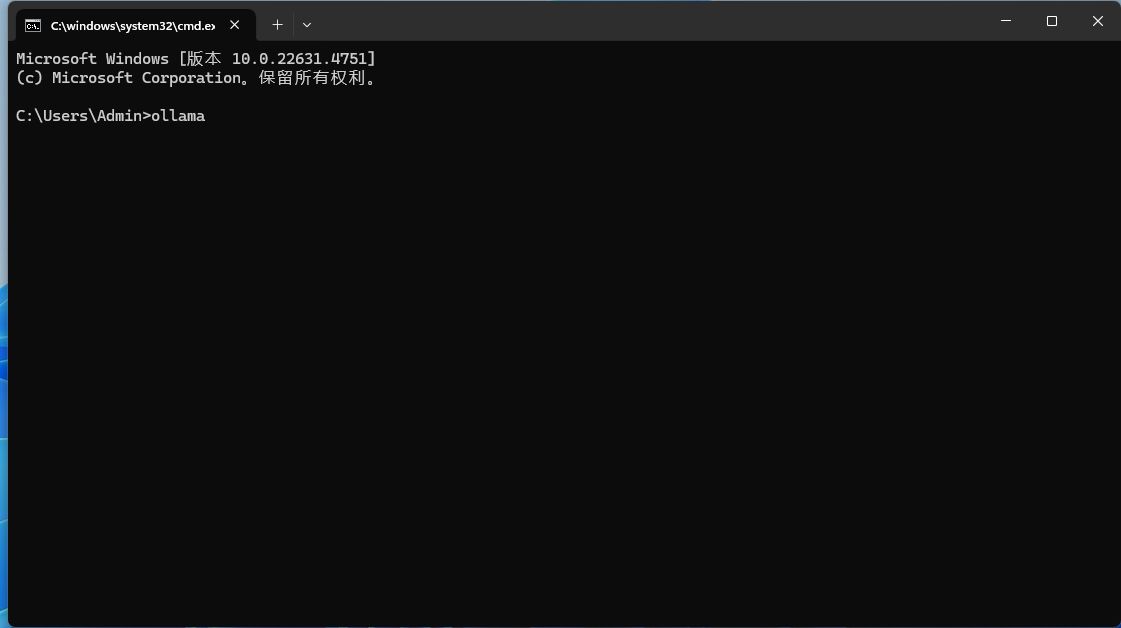

1.按win+R鍵,輸入 cmd ,回車打開。

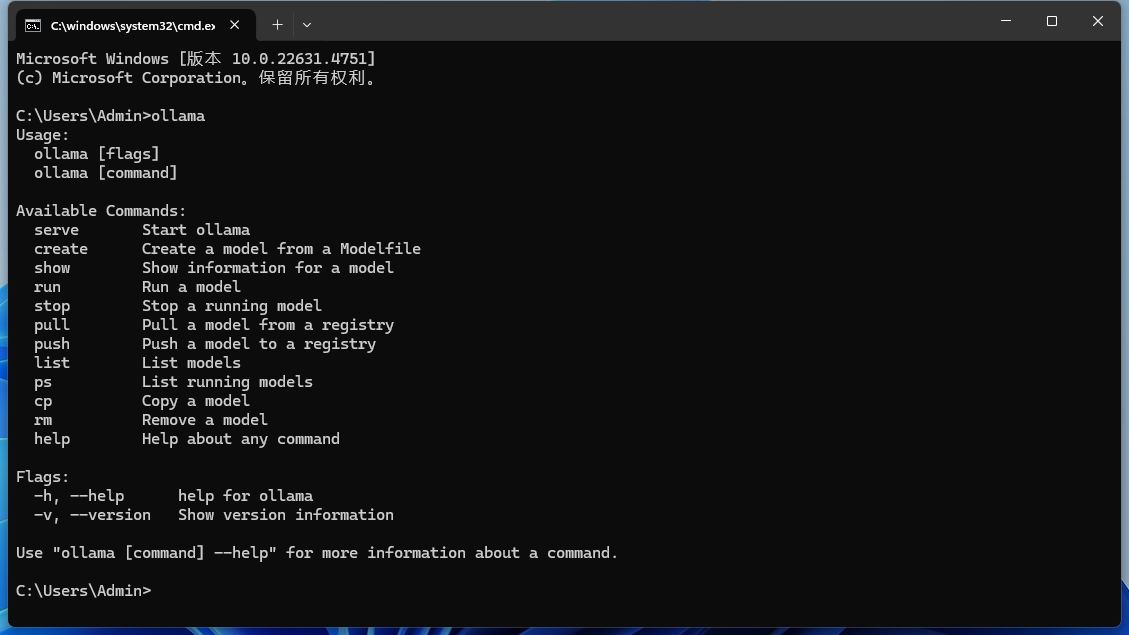

2.直接輸入ollama,彈出以下界面即為安裝成功。

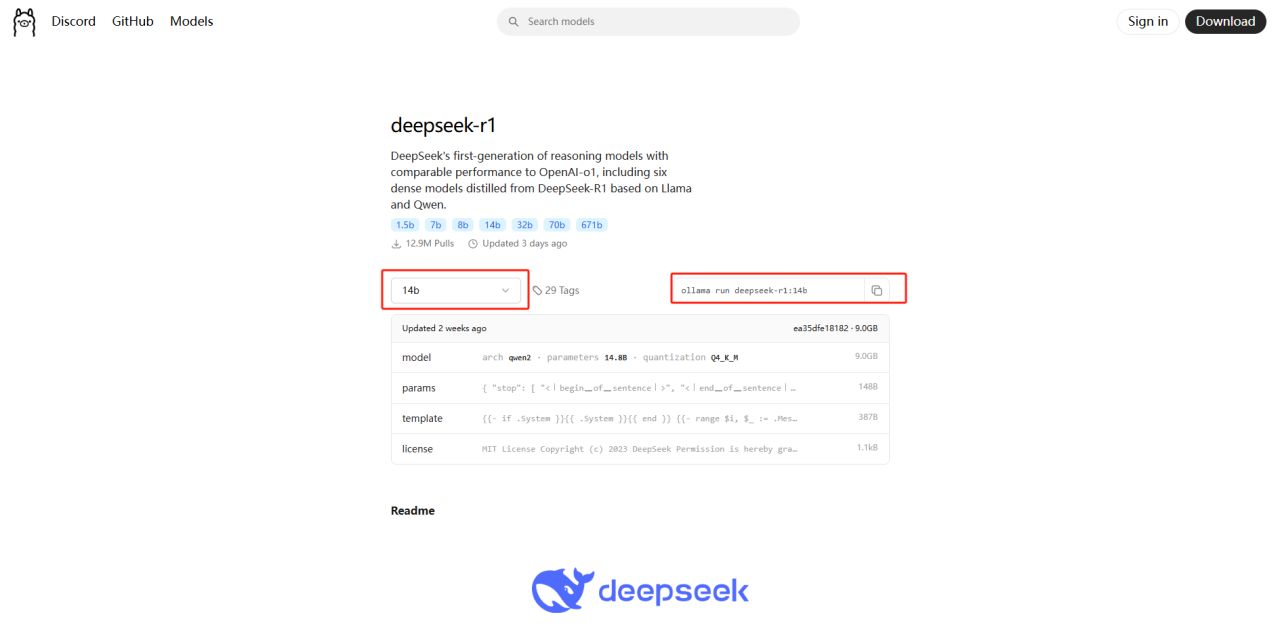

3.訪問ollama官網,選擇對應模型。

可以直接點擊deepseek或者搜索框搜索。

4.複製模型的下載碼

左側的 14b 意思是下載140億參數的R1,這個根據自己的電腦配置來,實測公司的電腦,無顯卡i3-12100,可流暢運行1.5b參數。家裡的 4070ti super,7800x3d,可無壓力運行14b參數,各位自營參考。

(參數越多,能力越強,官方部署的為671b的完整版本)

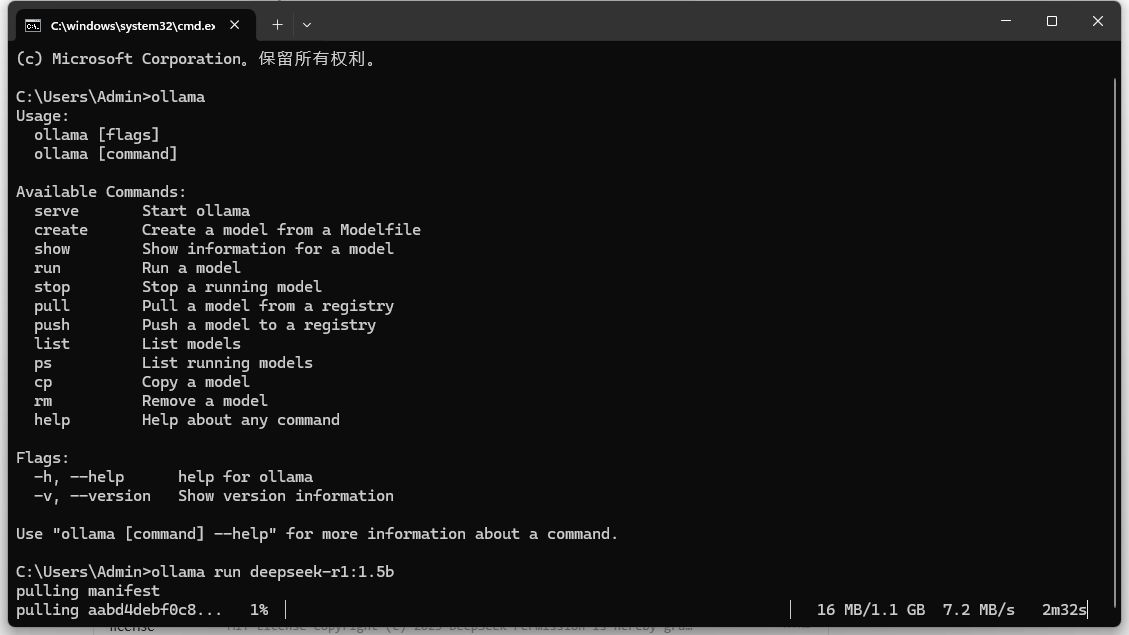

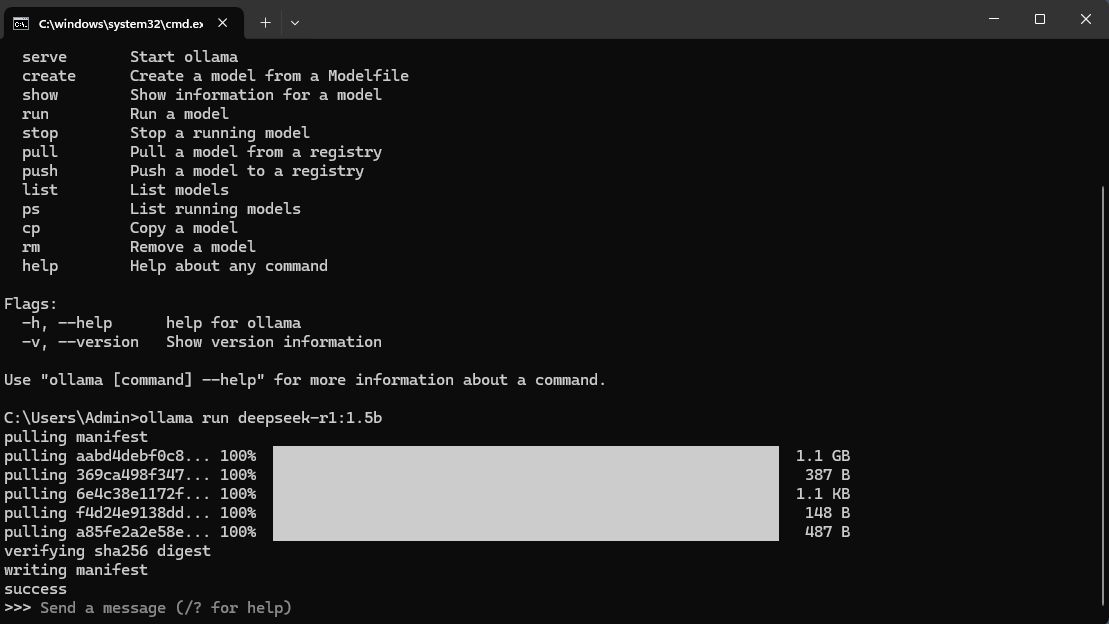

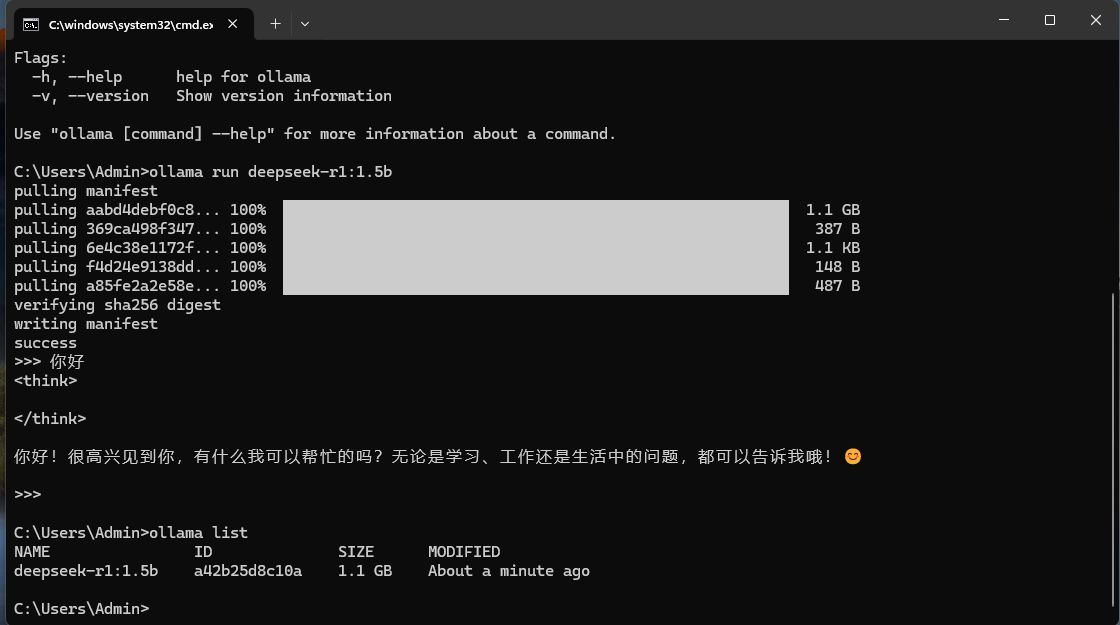

5.下載deepseek R1

在cmd界面輸入ollama

接著粘貼你在ollama官網複製的下載碼,我這裡以1.5b為例。等待下載完成

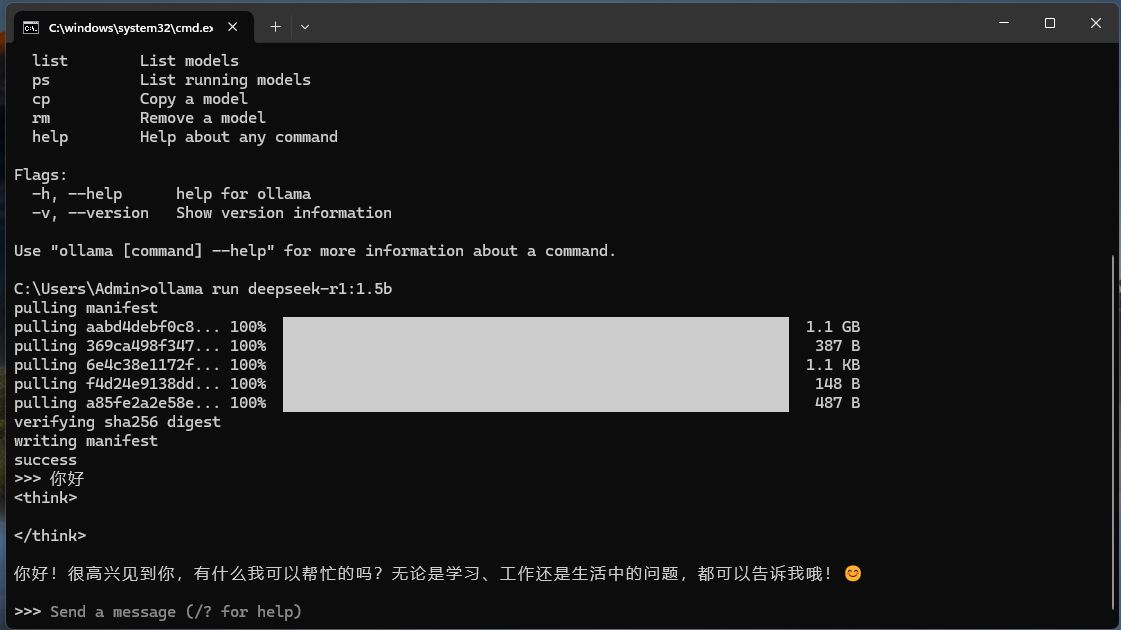

下載完成就可以使用了。

訪問其他模型辦法:

ollama還可下載其他模型,通過之前的辦法複製下載碼下載。在啟動時選擇自己想要的模型運營,具體方法如下。

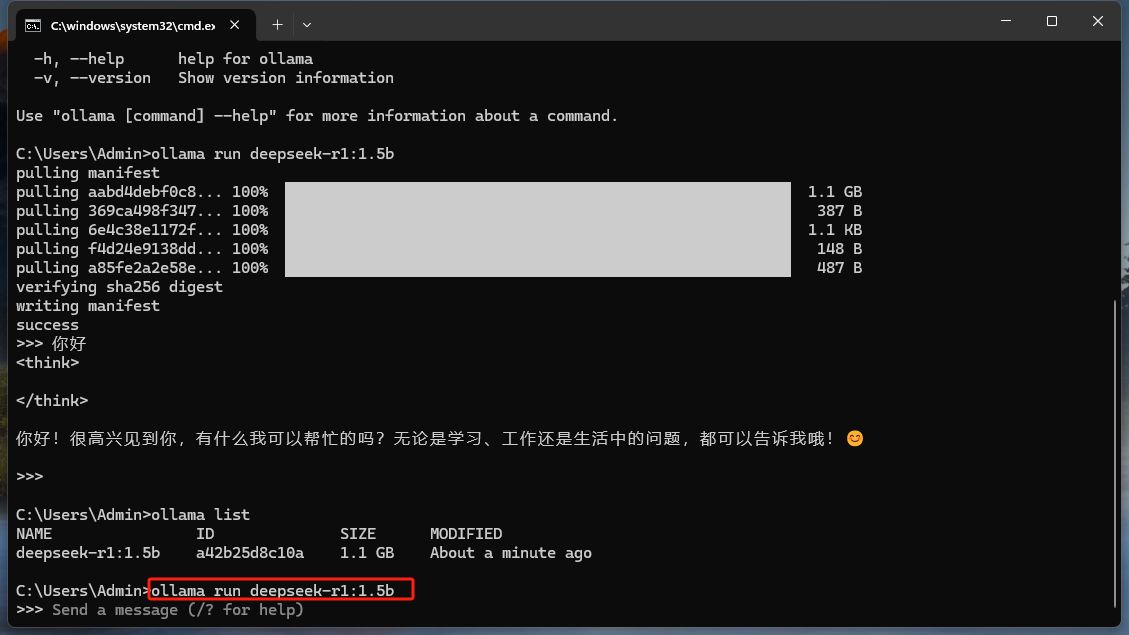

1.在cmd界面輸入ollama

2.接著輸入ollama list,可以看到你已經下載的所有模型。

3.接著輸入 ollama run (直接複製清單中你已經下載的模型就行,我這裡以1.5b的R1為例)

回車即可運行使用啦。

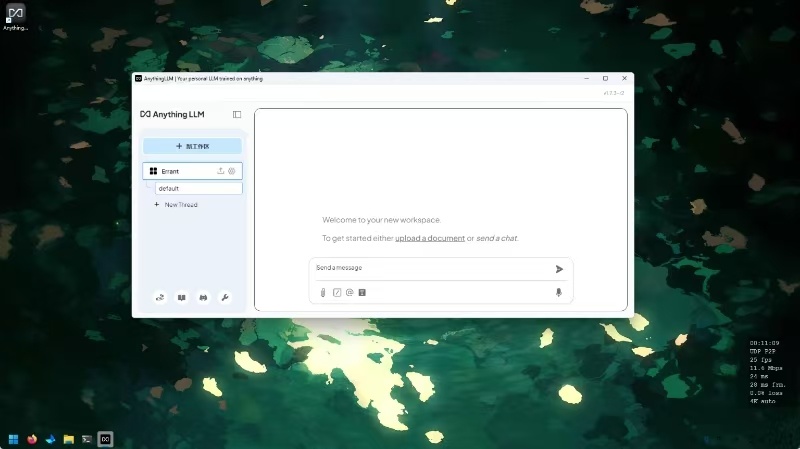

這個是最基礎的使用方法,還有通過llm studios,anything llm等應用可視化訪問,聯網搜索,接入酒館的方法,像這樣。

後續看情況更新。