本文的第一部分

本文的第二部分

本文的第三部分

复制心智过程·人工智能

在哥德尔定理与自指的探讨后,《GEB》提出了一个主要论题:思维的每一个方面,都可以看成是从较高的层次上描述的一个位于较低层次,受某些简单规则支配的系统。大脑这个位于较低层次的系统支撑着我们心智意识这一个高层次的“非形式系统”。之所以是“非形式”的,是因为“它”能灵活做出决策、随意使用“这个”“那个”、发现事物中的美感,甚至会忘记东西!而这些与一台机器相比简直大相径庭。

印度数学家拉马努金

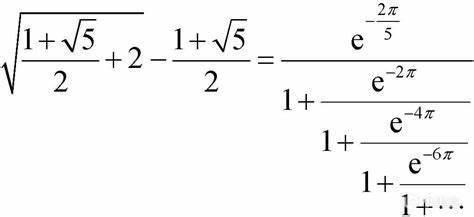

拉马努金恒等式

著名的印度数学家拉马努金(Srinivasa Ramanujan)没有受过高等教育,却能以自己天才般的的直觉发现复杂的数学定理,而他本人并没有对这些东西有严格的证明;弗兰克·赫伯特(Frank Herbert)笔下的《沙丘》中,人类在巴特勒圣战后禁止了计算机与人工智能,转而用有高级心算能力的人类“门泰特”来承担计算工作。拉马努金与门泰特,似乎就有这种区分的能力。那么这种能力有没有可能被计算机所复制呢?

2021版《沙丘》

如果把“真”“美”“简洁”这些东西看作是数论中的真陈述即定理的话,我们为了让计算机获取这种分辨的能力,似乎就需要在计算机中设置一个程序,来分辨数论中的定理与非定理。这种程序过程存在吗?很遗憾在《GEB》中,答案是否定的。书中将这个定理称为“塔斯基-丘奇-图灵定理”,其中的几位分别是波兰逻辑学家塔斯基(Alfred Tarski)、美国逻辑学家丘奇(Church)与英国的“人工智能之父”图灵(Alan Turing)。而他们都在这个问题上有相关的理论成果。这个定理的内容是:没有一种可靠的方法来区分数论语句的真假。这个定理的证明过程涉及到了“可预测终止”与不可预测有无终止”的递归循环函数(书中分别称为“BlooP”与“FlooP”),并且这个定理还有内容不同的同构形式,关于其证明在此实在是无法具体描述。

图灵测试

与判断数论中的定理与非定理这种“理性”的工作不同,“美感”、“道德感”、“共情能力”这些非理性的东西能否在计算机中再现呢?在一些刻板印象中,计算机是“机械的”的同时,也是“准确无误”的。对于美之类非理性因素的感知因而与计算机的条理性不符。然而,事实上,非理性的东西可以与理性的东西共存于不同的层次:计算机可以不出错误地按照底层的指令,在纸上打印出充满错误的语句。

同样地,我们在阅读思考“说谎者悖论”之类充满矛盾的符号串,感到困惑不解的同时,我们的神经系统却依然在遵循客观物理规律运行。因此,计算机的大量低层次子系统可能可以按照复杂的逻辑理性运作,而去支持混乱、遗忘、美感之类充满矛盾的非理性的高层次符号过程。那么,这种感到美之类的非理性行为的过程能被计算机所重构吗?

《WALL·E》中的机器人,似乎就实现了这种能力

感到美的过程完全不同于检验数论的定理与非定理,它是一种抽出“内在意义”或性质的过程,《GEB》提出了“句法性质”与“语义性质”两种不同的性质。对于前一种性质,即符号串中的“形式”,比如说对称性、主语谓语宾语关系之类的东西,我们可以用可预测有终止的递归循环函数(即BlooP)来检验。然而,对于后一种性质,即符号串消息传递的意义,我们却只能用无法预测是否有终止的递归循环函数(即FlooP)来检验!

维特根斯坦。他后期的著作《哲学研究》批判了他前期的著作《逻辑哲学论》

从雅克·德里达(Jacques Derrida)的解构主义(Déconstructivisme),再到维特根斯坦(Ludwig Josef Johann Wittgenstein)的“语言游戏”,即使我们能够为符号找到现实世界中的同构关系,但一个符号串的意义所在总是被它的上下文关系、解读主体、解读方式等等所决定,你无法穷尽它的所有可能!而一些非理性因素的性质则更为模糊,它不是上述两者的任何一个。在计算机中完整重构这种非理性过程的设想,也就成为了不可能。

如果判断数论中的定理与非定理这种计算过程在大脑中确确实实地存在着,那么它们都处于大脑的高层次,而最终被低层次的“硬件”所支持,而大脑的顶层似乎有一些“软件实体”在充当这种思维的角色。当我们讨论的范围仅仅局限于数论,思维的过程似乎还有迹可循。可面对复杂的现实世界,以及非理性因素的探讨,就得使用更加复杂的方式来激活大脑的思维过程。

神经细胞

在大脑神经细胞的层次,脉冲产生的信号可以没有解释,仅仅是生物活动的电信号;而在大脑的顶层,却出现了符号有意义的解释——与现实找到了某种同构的映射,这与哥德尔的过程十分相似。然而,在哥德尔的过程中,我们可以从配数这个低层次上的东西完整找出高层次的数学语句;但在大脑中,神经细胞的活动并不是对现实世界的解释,它们纯粹是实现较高层次思维过程的基质!

这意味着虽然心智的高层次符号过程是从低层次的神经细胞中产生的,我们却难以将这种过程从低层次抽取出来。而这里又涉及了整体论与简化论的探讨。

埃舍尔《相对性》

所以,既然完整抽取这种思维过程是不可能的,我们得使用计算机将大脑模拟到什么精度才算实现了真正的人工智能?像《三体》中的比尔·希恩斯与山杉惠子那样用巨量的硬件来模拟每个神经细胞的状态,进而模拟整个大脑的行为,是不是真正做到了1:1重现人类的心智呢?《GEB》提出,答案完全依赖于你想要模拟人类心智意识的多少特征。

如果你想要下围棋能轻松战胜人类围棋大师的人工智能,那么“AlphaGo”已经有了;如果你想要能对话、能搜集资料、能辅助工作的人工智能,那么“ChatGPT”也已经有了。但是,虽然“ChatGPT-4.0”已经“聪明”到能够通过图灵测试,但它还有根本上的局限性,它只是通过海量数据训练而成的大语言模型,依然有缺乏自己的深度理解、无法预测事物的发展等不足。就像美国哲学家约翰·赛尔(John Searle)提出的“中文屋悖论”(The Chinese Room Argument)一样,你如何证明人工智能真正懂了中文,拥有了真正的智能,而不是仅仅懂将中文翻译成英文的程序呢?但是,如果超级AI都不能做到100%模仿人类大脑,那什么才算是真正的自我意识,什么才是真正的心智呢?

(未完待续)