我最近開發了一款 Windows 端實時字幕工具,基於Whisper + LLMs,使用 Flutter 和 Rust 。

Github:https://github.com/xkeyC/fl_caption

演示視頻:https://www.bilibili.com/video/BV1VyQtYMEWA

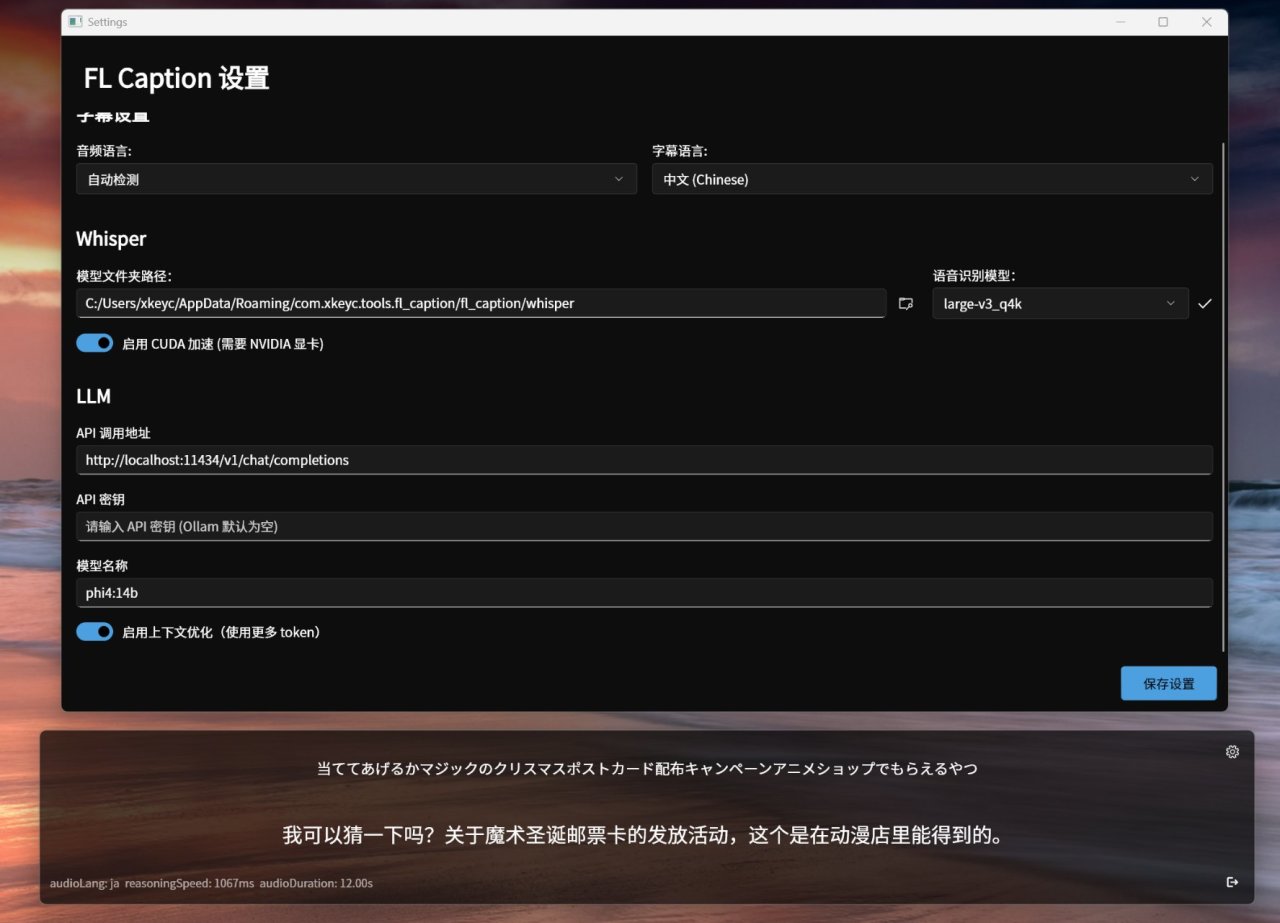

使用 Whisper + LLM 實現高質量的音頻轉錄與翻譯,目前為 llm 直出效果,計劃開發字幕知識庫用於優化專有名詞翻譯效果,這樣在不同場景使用對應的知識庫即可大幅改善字幕質量。

目前僅支持 Windows 端,建議使用 Nvidia 顯卡配合 cuda 加速。 實時字幕對延遲要求比較高,建議使用 ollama 、vllm 、llm studio 等本地 llm api ,雲端若延遲比較低也可以考慮(比較昂貴)。

在 RTX4090 上測試 large-v3-turbo 模型,12 秒的語音數據 基本在 0.5 秒內處理完畢。配合 14b llm模型,顯存佔用大約是 18 GB ,根據用戶反饋,8G 顯存可使用量化版語音模型+7b llm,也可以獲得比較不錯的翻譯效果。